Falso Falso Falso Falso Falso Falso Falso Falso

Falso

Viernes, 27 Febrero 2026

Falso video de archivos Epstein sobre niña embarazada mezcla IA y una grabación ajena al caso

Por Sharon D' Mejía

La escena donde aparece el pederasta fue creada con inteligencia artificial a partir de una foto antigua y el fragmento de la infante circula desde 2024 sin ninguna relación con ese expediente.

3 DATOS CLAVE:

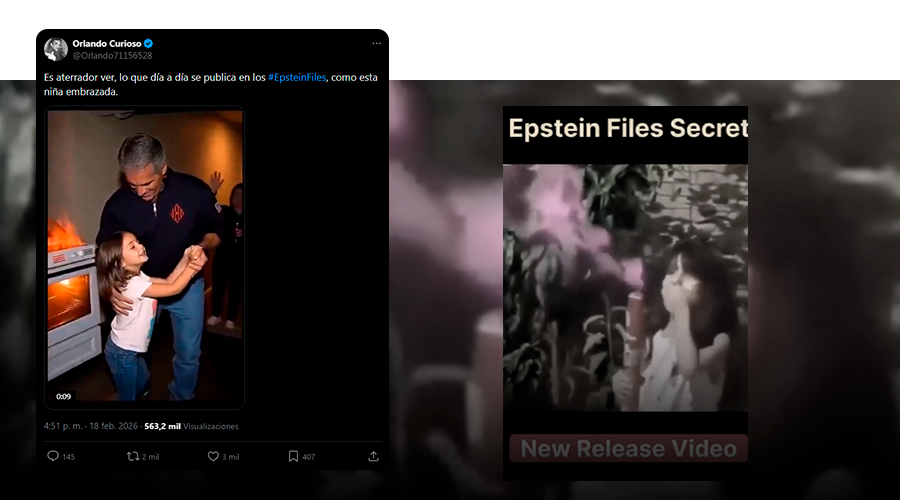

- Un video falso en redes afirma mostrar un nuevo archivo del pederasta Jeffrey Epstein, en el que supuestamente aparece bailando con una niña, seguido de un clip donde supuestamente sale otra “embarazada”.

- La escena de la fiesta fue generada con inteligencia artificial, según varios indicios y detectores, a partir de una fotografía real tomada en 2005 donde se ven mujeres sin identificar, pero ninguna es una infante como la del producto sintético.

- El fragmento de la supuesta “niña embarazada” con una bengala circula desde el 2024 y no tiene relación con el expediente del explotador sexual. Se trata de un video actuado que fue publicado originalmente en redes sociales.

Un video falso de 14 segundos que presenta dos escenas como si hubieran sido recién divulgadas a partir de los archivos del depredador sexual Jeffrey Epstein.

En una, aparece él sonriendo y bailando junto a una niña pequeña. En el segundo seis, cambia y muestra a otra menor sola —distinta a la anterior— que sostiene una bengala que emite humo rosa, similar a las utilizadas en celebraciones de revelación de género.

El contenido combina dos técnicas de desinformación. Primero, una imagen de archivo manipulada digitalmente con inteligencia artificial (IA). Luego, un video dramatizado que saca de contexto, porque en realidad no tiene nada que ver con el expediente del pederasta.

La pieza fue publicada en Colombia el 18 de febrero de 2026 por la cuenta de X ‘Orlando Curioso’ (@Orlando71156528), que previamente ha difundido contenido desinformador. Hasta el momento acumula más de 562.000 visualizaciones, cerca de 3.000 ‘me gusta’ y más de 2.000 compartidos. El trino incluye la descripción: “Es aterrador ver, lo que día a día se publica en los #EpsteinFiles, como esta niña embrazada”(sic).

Video de Epstein bailando con una niña fue hecho con IA

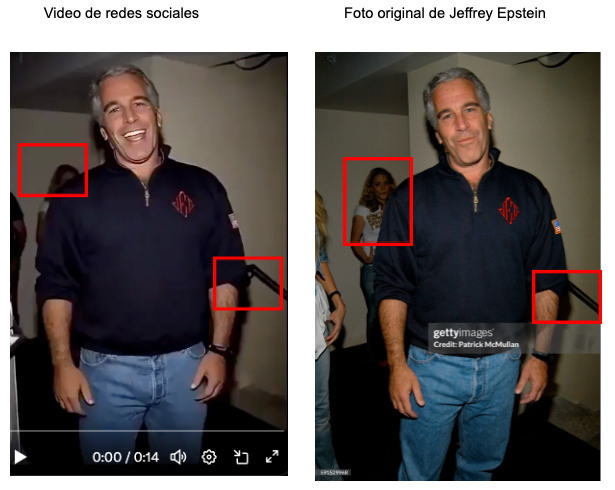

Para rastrear el origen del material, realizamos una búsqueda inversa de imágenes con Google Lens. El análisis nos llevó a una fotografía con el mismo encuadre y escenario, pero en ella Epstein aparece solo y sin la niña que se observa en el clip viral.

La foto original ha sido publicada por medios internacionales como The New York Times en un artículo titulado “El rastro del lujo: así usaba Epstein los regalos para afianzar relaciones”, publicado el 6 de febrero de este año. Según el crédito, la fotografía proviene del archivo de Getty Images.

Al consultar el repositorio encontramos la original, que fue tomada el 18 de mayo de 2005 durante la inauguración de la revista Radar. Los créditos corresponden a los fotógrafos Neil Rasmus y Patrick McMullan. Fue subida a la plataforma el 17 de agosto de 2016.

Tanto la imagen original como el falso audiovisual comparten elementos idénticos, como la baranda de una escalera, detalles del techo y la presencia de personas al fondo. Sin embargo, en el video sintético aparecen objetos y personas que no existen en la fotografía.

Por ejemplo, en el costado izquierdo del retrato se observa parcialmente el cuerpo de una persona rubia. En el clip manipulado, en ese mismo espacio aparece una estufa que es movida por un hombre, mientras el fuego parece encenderse sin fuente visible. También ingresan figuras humanas con contornos poco definidos, desaparece la escalera del fondo y surge la niña que no estaba en la toma auténtica.

Además, durante el supuesto baile, las iniciales bordadas en el saco de Epstein (“JEE”) se deforman y se borran parcialmente, algo característico en contenidos generados o alterados con inteligencia artificial.

Para reforzar el análisis, sometimos el video a herramientas de detección de contenido sintético. La plataforma Hive Moderation arrojó una alta probabilidad de generación artificial, mientras que Sora AI Detector y Deepware registraron porcentajes menores.

No obstante, estos detectores no son concluyentes por sí solos y sus resultados pueden variar según la calidad del archivo. En este caso, la conclusión de que es IA se sostiene al sumarlos con las señales visuales y el hallazgo de Google Lens.

Actuación de niña con bengala no tiene relación con el caso

Para identificar el origen del segundo fragmento incluido en la pieza desinformadora —en el que aparece una niña sosteniendo una bengala con humo rosa—, realizamos otra búsqueda inversa de imágenes. El rastreo nos llevó a múltiples publicaciones en redes sociales como Facebook, Reddit e Instagram, todas fechadas en 2024, es decir, anteriores a la narrativa que lo vincula con los llamados “archivos Epstein”.

Una segunda búsqueda con un fotograma de mayor calidad condujo a una publicación de la organización turca de verificación Malumatfuruş, que chequeó el mismo video en la red social X el 15 de enero de 2025. Allí desmintió explicó que el original fue publicado el 20 de julio de 2024 por una cuenta dedicada a compartir dramatizados de una infante. Según detalla el perfil de Instagram, la cuenta es supervisada por los padres.

Ese mismo día, ese perfil publicó otro audiovisual en el que aparece la misma niña usando el mismo vestido. Allí, ella interpreta distintos personajes y no tiene el abdomen abultado como en la escena viral, lo que refuerza que se trata de un contenido actuado.

El video falso, difundido en una cuenta frecuentemente desinformadora en Colombia, aprovecha la indignación por los crímenes de Epstein para ganar viralidad. En el proceso, no solo se vale de un uso problemático de la IA, al generar desinformación sobre un caso judicial delicado con víctimas reales, sino que también juega con los derechos y la salud mental de una niña de verdad que nada tiene que ver con este expediente de explotación sexual infantil con el que ahora la relacionan en redes.

Cuentas que difundieron la desinformación

En X:

Orlando Curioso (@Orlando71156528): 562.000 visualizaciones, cerca de 3.000 ‘me gusta’ y más de 2.000 compartidos.