Falso Falso Falso Falso Falso Falso Falso Falso

Falso

Viernes, 14 Junio 2024

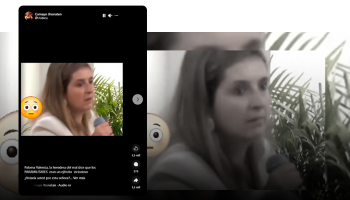

Video de Karol G promocionando proyecto de inversión fue alterado, probablemente con IA

Por María Mónica Acuña Berrio

La supuesta invitación de la cantante muestra signos del uso de inteligencia artificial para imitarla y redirige a un grupo de Telegram para captar dinero.

3 DATOS CLAVE:

- Un video manipulado presenta a la cantante Karol G supuestamente promoviendo una inversión inicial de 215.000 pesos para un proyecto de una persona llamada Allison Castillo.

- En la verdadera entrevista con la revista Elle, la artista paisa habló sobre otros temas, como su álbum ‘KG0516’, su éxito en la lista Top Latin Albums de Billboard y su popularidad en Spotify.

- El audio del video tiene indicios de haber sido generado con inteligencia artificial: no coincide con la voz natural de la cantante y una herramienta de detección de IA indicó que hay una alta probabilidad del uso de esta tecnología para imitarla.

Desde el 13 de mayo, en la página de Facebook ‘Allison Castillo’ circula un video que aparenta ser una entrevista con la cantante Karol G en la que invita a participar en un supuesto proyecto de inversión con una cuota inicial de 215.000 pesos.

El audiovisual lleva el título: “Si tienes 215 mil pesos puedes hacerte rico”. En él, la artista supuestamente dice:

“Hola, soy Karol G. Si tienes 215.000 pesos, puedes hacerte rico. Alison Castillo y yo hemos creado un programa para ayudar a todos los colombianos que quieren triunfar en la vida. Muchos de nuestros clientes han comprado un carro, pagado sus deudas, adquirido una casa y han mejorado su nivel de vida. Muchos colombianos ya están recibiendo pagos del programa de Allison Castillo. Para participar, suscríbase al canal y envíe un escribia a Allison” (sic).

Mientras se escucha el audio, las imágenes muestran casas, camionetas, personas recibiendo supuestas notificaciones del Banco de la República en sus celulares y fotos de la mencionada Allison Castillo. Este nombre coincide con el de la supuesta intermediaria de inversiones en un proyecto atribuido al gobierno de Gustavo Petro, que resultó ser un montaje con la imagen y una imitación de la voz del presidente.

Al final del video, aparece un mensaje que dice: “Suscríbete al canal de Telegram”. El enlace redirige a un grupo en esa plataforma de mensajería instantánea llamado “🇨🇴Alisson Ingresos🇨🇴”.

Colombiacheck determinó que el video es falso. Se trata de un montaje que utiliza un fragmento de una entrevista de Karol G en la revista Elle, combinado con otros clips y una voz manipulada, aparentemente mediante inteligencia artificial (IA).

La página es administrada desde Asia y se promociona con publicidad pagada

El audiovisual circula desde el 13 de mayo de 2024 en la página “Allison Castillo”, identificada como una “comunidad” con supuesta sede en California. Sin embargo, la página de transparencia de Facebook indica que es administrada por dos cuentas en Vietnam y una en Pakistán. Además, se señala que fue creada el 14 de octubre de 2020 bajo el nombre de Yrse y que el 30 de abril de 2024 se cambió a Allison Castillo. Actualmente, cuenta con 1.800 seguidores.

Además, hallamos que también existen varias cuentas en Facebook bajo el nombre de “Allison Castillo”. Aunque tienen diferentes fotos de perfil, utilizan estrategias similares para promocionar diversos canales de Telegram y enlaces para supuestas inversiones.

En una de las cuentas alternas de “Allison Castillo” que publica contenido de esta supuesta persona, se identificó que el mismo video con Karol G está siendo promocionado mediante publicidad pagada en Facebook. Esto según (1) la Biblioteca de Anuncios de Meta, compañía propietaria de la plataforma.

La entrevista original de Elle

Primero realizamos una búsqueda inversa en Google de un fotograma del video y encontramos una entrevista en la página de la revista Elle, titulada “KAROL G canta Daddy Yankee, P!nk y ‘LOCATION’ en un Game of Song Association”, publicada el 20 de abril de 2021, que también circula en la cuenta de YouTube del medio. En la entrevista, la cantante aparece con la misma ropa y peluca que en el video que circula en redes sociales.

Sin embargo, en el diálogo original, la cantante no menciona el supuesto proyecto de inversión que se le atribuye ni a la tal Allison. Durante los 6:28 minutos que dura la entrevista, habló sobre su álbum ‘KG0516’, su permanencia en la lista Top Latin Albums de Billboard y su distinción como una de las artistas femeninas más reproducidas en Spotify, además de interpretar canciones de sus artistas favoritos.

Al comparar el video falso con la entrevista real, notamos varios detalles que indican manipulación. Por ejemplo, en la desinformación hay un titular en letras blancas escrito sobre un fondo violeta; en la grabación original no hay texto superpuesto.

También revisamos las cuentas oficiales de Karol G en X, Facebook e Instagram, pero no encontramos ninguna información sobre el supuesto video o proyecto de inversión.

La voz tiene signos de generación con IA

Al comparar partes de la entrevista en Elle con el contenido del video viral, notamos que la voz en la desinformación carece de pausas naturales y presenta errores de pronunciación propios de las voces generadas por inteligencia artificial. Además, la velocidad y la entonación no corresponden a la forma habitual de hablar de la cantante.

Por ejemplo, en el video de Facebook, cuando dice: “Hola, soy Karol G”, se refiere a sí misma pronunciando su nombre artístico como Karol ‘Ge’ y no como Karol ‘Yi’, que es la forma en la que se lee esa letra en inglés y como ella se ha dado a conocer.

En el video de redes, el habla de la cantante se escucha más rápido de lo habitual. Sin embargo, en la entrevista original de Elle, su tono es más pausado. Además, la cantante tiene un acento paisa, que no se percibe en la voz del video viral, donde se escucha más parecido al mexicano.

El video habría sido alterado con IA

En Colombiacheck analizamos el video utilizando la herramienta TrueMedia.org, diseñada para detectar ‘deepfakes’ (archivos manipulados con inteligencia artificial). Los resultados indican una alta probabilidad de que el video haya sido creado con IA. El análisis del rostro muestra un 96% y el del audio, un 85%. Lo que sugiere que tanto el video como el audio probablemente fueron alterados con esa tecnología.

Alejandro Lozada, físico y periodista especializado en datos, nos explicó en una verificación anterior que existen ciertas señales que pueden indicar el uso de inteligencia artificial para generar audios. Entre estas se encuentran la falta de sincronización entre el movimiento de los labios y el audio, así como la ausencia de errores de pronunciación o correcciones en la voz, lo cual sugiere que un guión ha sido leído por una herramienta digital.

En la verificación titulada “Posibles audios creados por IA llegan a las elecciones regionales, ¿qué tan factible es identificarlos?”, Lozada explicó que los audios generados con inteligencia artificial pueden ser creados a partir de grabaciones de la voz de una persona, utilizando herramientas disponibles tanto gratuitas como de pago en internet.

“Antes era necesario enviar una muestra de audio de 20 minutos o media hora, y el resultado sonaba un poco robótico. Ahora, con una muestra de un minuto es suficiente. Esto abre muchas puertas para que cualquier persona que hable en internet pueda ver su voz replicada en uno de estos modelos”, señaló.

En el pasado, hemos verificado publicaciones similares que promocionan proyectos de inversión falsos utilizando imágenes de figuras públicas. Estas contienen audios manipulados con montajes de voz y, en algunos casos, dirigen a los usuarios a sitios web fraudulentos o de estafa. Aquí algunos ejemplos:

- Criptoaplicación usa video manipulado de Noticias Caracol para vincularse a tres banqueros como anzuelo

- Usan voz de Shakira posiblemente creada con IA para invitar a supuesto proyecto de inversión

- Video de Álvaro Uribe en Noticias Caracol recomendando un proyecto de inversión es un montaje

En conclusión el anuncio que presenta a Karol G en una supuesta entrevista en la que habla de un proyecto de inversión de Allison Castillo es falso. Este montaje, aparentemente realizado con IA, manipula una entrevista en la que la cantante toca otros temas, no ese.